【深度学习】变压器【Transformers】教程

这个存储库包含我用HuggingFace的Transformers库制作的演示。

这个存储库包含我使用Transformers库制作的演示🤗 拥抱脸。目前,所有这些都在PyTorch中实现。

注:如果您不熟悉HuggingFace和/或Transformers,我强烈建议您查看我们的免费课程,该课程向您介绍了几种Transformer架构(如BERT、GPT-2、T5、BART等),以及HuggingFace库的概述,包括Transformers、Tokenizer、Dataset、Accelerate和hub。

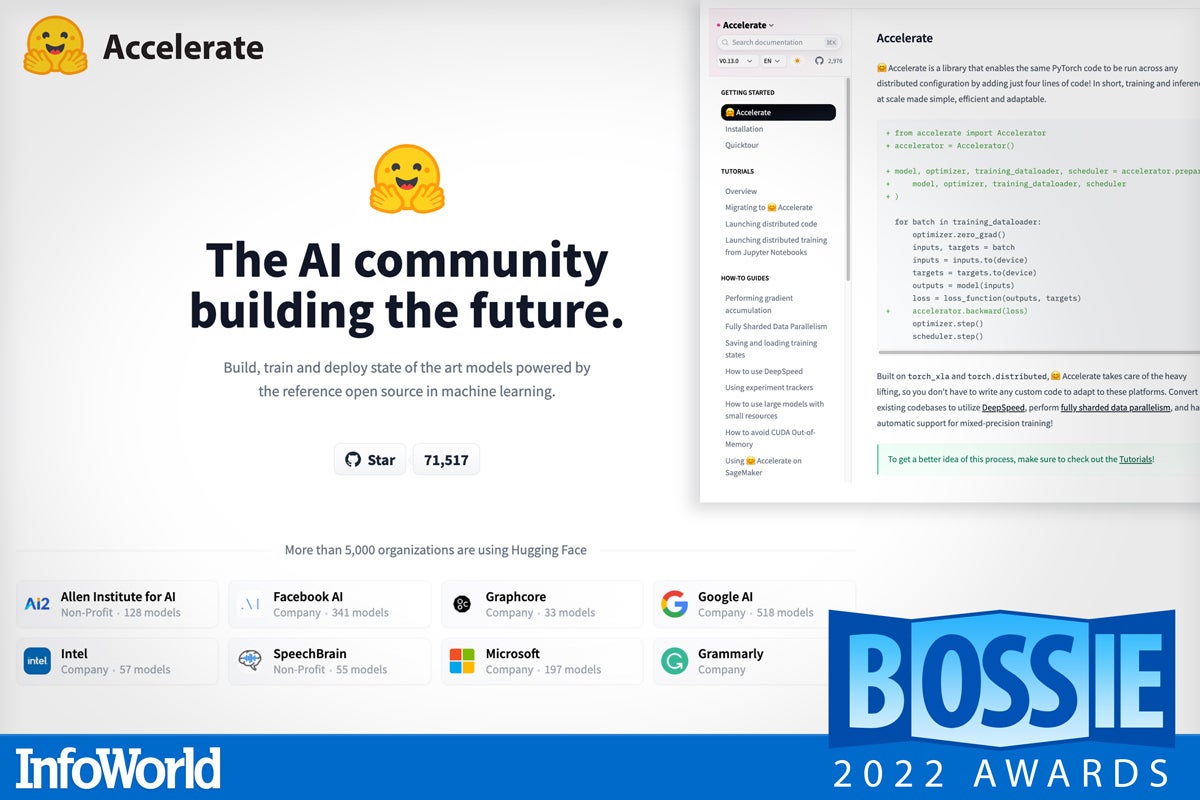

【开源软件】最好的开源软件-2022-第26名 Accelerate

如果只需添加四行代码,就可以将大规模的分布式训练和推理添加到任何PyTorch代码中,会怎么样?Huggingface的Accelerate开箱即用,允许您通过简单的配置开关使用TPU设备或微软的DeepSpeed优化等功能。是的,您可以使用分布式训练、分片并行和梯度积累等技术,在十亿参数规模上训练深度学习模型,所有这些都由Accelerate库在幕后处理。确保大模特的培训不仅限于行业中的重量级人物,这对多样性和实验性很重要,因此看到Accelerate成为PyTorch生态系统的一部分令人振奋。

——Ian Pointer

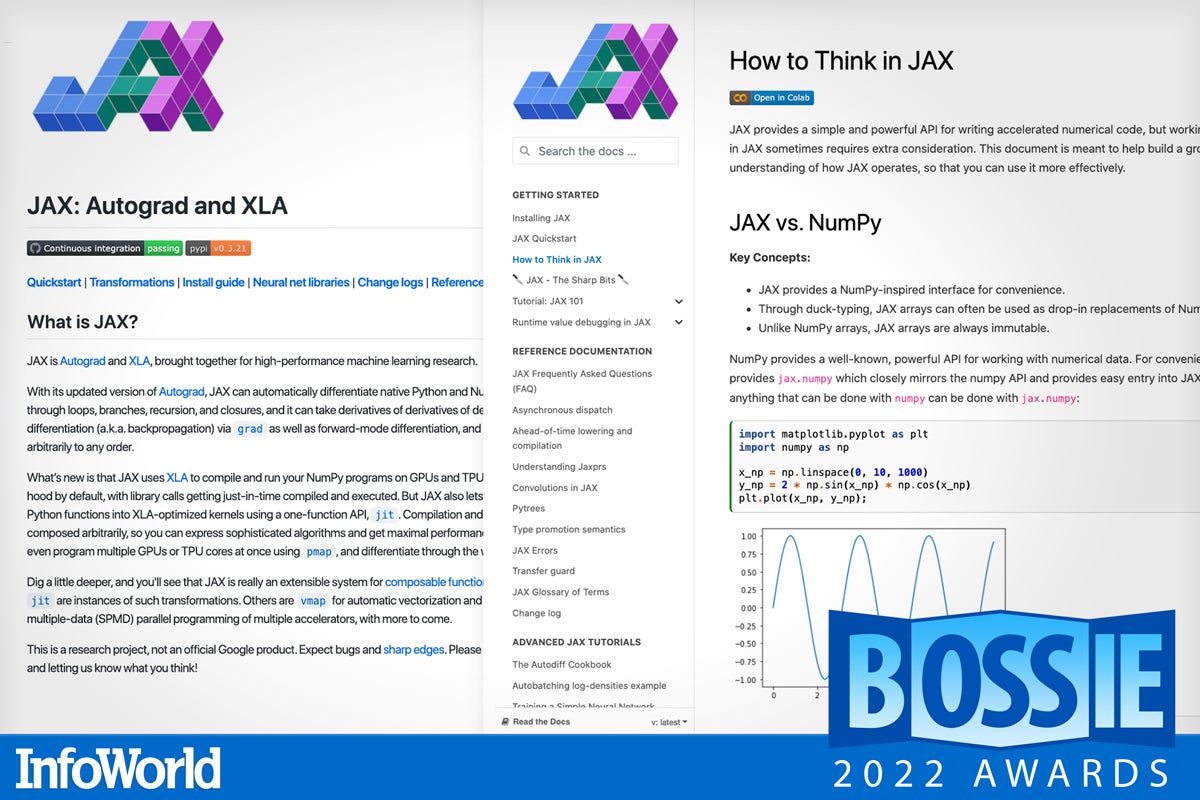

【开源软件】最好的开源软件-2022-第24名 JAX

谷歌广受欢迎的开源TensorFlow机器学习平台的创新包括自动微分(Autograd)和用于深度学习的XLA(加速线性代数)优化编译器。JAX同样来自谷歌,是另一个将这两种技术结合在一起的项目,它在速度和性能方面提供了相当大的好处。当在GPU或TPU上运行时,JAX可以替换其他调用NumPy的程序,但它的程序运行得更快。(Autograd引擎可以自动区分原生Python和NumPy代码。)此外,将JAX用于神经网络可以使添加新功能比扩展TensorFlow等更大的框架更容易。

——马丁·海勒

【2vec向量化模型】真棒的2vec向量化模型

Curated list of 2vec-type embedding models

If you know of 2vec-style models that are not mentioned here, please do a PR!

For network/graph-specific embedding models have a look here: https://github.com/chihming/awesome-network-embedding

The list

word2vec

【图像修复】令人敬畏的图像修复

A curated list of inpainting papers and resources, inspired by awesome-computer-vision.

【torch】真棒的torch

A curated list of awesome Torch tutorials, projects and communities.

【轨迹预测】真棒轨迹预测

This is a list of useful information about trajectory prediction. Related papers, datasets and codes are included.

Maintainer - Hao Xue

News

A PyPi package of trajectory prediction tools is published!

Contributing

Please feel free to pull requests to add new resources.

【边缘检测】很棒的边缘检测论文

【NLP】用于自然语言处理 (NLP) 的出色深度学习

Table of Contents

【Caffe】很棒的Caffe

This page contains a curated list of awesome Caffe examples, tutorials and blogs. It is inspired by awesome-php and awesome-machine-learning.

Contributing

If you think I have missed out on something (or) have any suggestions (papers, implementations and other resources), feel free to pull a request

Feedback and contributions are welcome!